你知道吗?现在这个AI技术真是厉害得不得了,连Skype视频通话都能造假,这可真是让人防不胜防啊!想象你正和远方的朋友视频聊天,突然间,屏幕上的人换了一张脸,这可真是让人心头一紧。别急,今天咱们就来聊聊这个Skype视频通话造假的话题,看看怎么防范,怎么治理。

揭秘Skype视频通话造假

随着AI技术的发展,深度伪造技术已经可以轻松地改变人脸、声音、手势动作等,甚至可以实现实时视频通话的造假。这种技术一旦被不法分子利用,后果不堪设想。比如,有人可能会冒充你的亲朋好友,通过Skype视频通话向你借钱,或者进行其他诈骗活动。

技术门槛降低,造假变得容易

你知道吗,现在这个AI合成技术的门槛其实并不高,甚至有些软件和平台都提供了相应的工具。这就意味着,普通人只要稍微动动手指,就能轻松地制作出假视频。这种情况下,我们该如何防范呢?

防范措施,你做到了吗?

1. 核实身份:在视频通话中,一定要核实对方的身份,尤其是涉及到金钱交易的时候。可以通过电话、短信等多种方式确认,不要轻易相信视频中的信息。

2. 谨慎分享信息:在视频通话中,不要轻易透露自己的个人信息,比如银行账号、密码等。这些信息一旦被不法分子获取,后果不堪设想。

3. 安装安全软件:现在市面上有很多安全软件,可以帮助你识别和防范视频通话中的造假行为。安装这些软件,可以大大降低被骗的风险。

治理措施,多方合力

面对AI视频通话造假的问题,仅仅依靠个人防范是远远不够的。我们需要多方合力,共同治理。

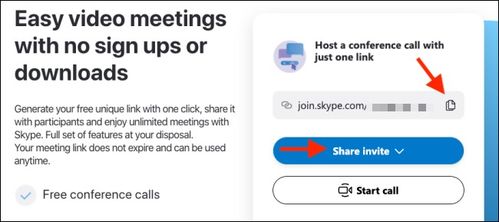

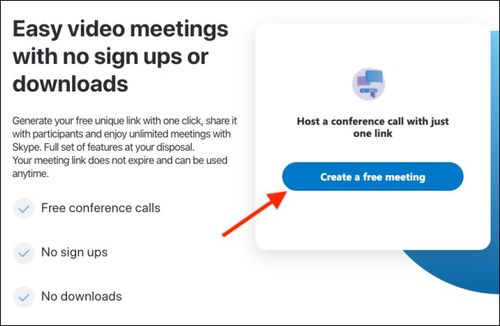

1. 平台责任:Skype等视频通话平台应该加强对用户上传内容的审核,一旦发现造假行为,立即采取措施制止。

2. 法律监管:政府部门应该加强对AI技术的监管,制定相关法律法规,对利用AI技术进行诈骗的行为进行严厉打击。

3. 公众教育:通过媒体、网络等渠道,加强对公众的宣传教育,提高大家的防范意识。

AI生成合成内容将有专属水印

好消息是,国家网信办已经起草了《人工智能生成合成内容标识办法(征求意见稿)》,要求通过人工智能生成的视频、音频、图片都必须加以明确的标识。这样一来,我们在看到这些内容时,就能知道它们是AI生成的,从而提高警惕。

老年人如何防范AI换脸诈骗?

对于老年人来说,防范AI换脸诈骗更是至关重要。以下是一些建议:

1. 提高警惕:老年人要时刻保持警惕,不要轻易相信陌生人的视频通话。

2. 多与家人沟通:在遇到可疑情况时,要及时与家人沟通,寻求帮助。

3. 学习相关知识:老年人可以学习一些关于AI技术的相关知识,提高自己的防范能力。

面对AI视频通话造假的问题,我们既要提高自己的防范意识,也要依靠多方合力,共同治理。只有这样,我们才能在这个AI时代,更好地保护自己,享受科技带来的便利。